متا از شبکههای تولید محتوای جعلی توسط هوش مصنوعی پرده برداشت

شرکت متا در گزارش امنیت سایبری خود از شناسایی شبکههایی خبر داده است که از محتوای تولیدشده توسط هوش مصنوعی برای انتشار اطلاعات فریبنده در پلتفرمهای فیسبوک و اینستاگرام استفاده میکردند. این موضوع نشاندهندهی چالش جدیدی برای این شرکت و سایر غولهای فناوری در مقابله با سوءاستفاده از هوش مصنوعی در فضای آنلاین است. استفاده […]

شرکت متا در گزارش امنیت سایبری خود از شناسایی شبکههایی خبر داده است که از محتوای تولیدشده توسط هوش مصنوعی برای انتشار اطلاعات فریبنده در پلتفرمهای فیسبوک و اینستاگرام استفاده میکردند. این موضوع نشاندهندهی چالش جدیدی برای این شرکت و سایر غولهای فناوری در مقابله با سوءاستفاده از هوش مصنوعی در فضای آنلاین است.

استفاده از هوش مصنوعی مولد

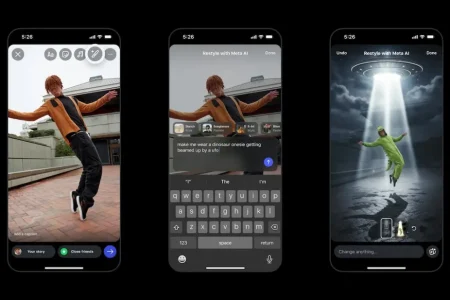

به گزارش سرویس امنیت رسانه اخبار فناوری تکنا این گزارش برای اولین بار به استفاده از فناوریهای پیشرفتهتر «هوش مصنوعی مولد» (Generative AI) در عملیات فریب اطلاعاتی اشاره میکند. هوش مصنوعی مولد به دلیل توانایی تولید سریع و ارزان متن، تصویر و صدای شبیه انسان، میتواند در انتشار اخبار جعلی و محتوای گمراهکننده بسیار موثر باشد.

شبکههای نفوذ

متا در این گزارش شش نمونه از شبکههای نفوذ را که در سه ماهه اول سال ۲۰۲۴ شناسایی و مختل کرده است، ارائه میدهد. یکی از این شبکهها، به شرکت بازاریابی سیاسی STOIC مستقر در تلآویو نسبت داده شده است. این شبکه با ایجاد حسابهای کاربری جعلی و انتشار محتوای فریبنده در مورد درگیری اسرائیل و حماس، به دنبال تاثیرگذاری بر افکار عمومی در ایالات متحده و کانادا بود.

چالشهای پیش رو

شناسایی شبکههای نفوذ مبتنی بر هوش مصنوعی چالش جدیدی برای متا و سایر پلتفرمهای آنلاین محسوب میشود. این پلتفرمها باید به طور مداوم روشهای خود را برای شناسایی و حذف محتوای جعلی و فریبنده به روزرسانی کنند.

علاوه بر این، شرکتهای فناوری باید با نهادهای قانونگذار و محققان برای تدوین قوانین و دستورالعملهایی برای استفاده مسئولانه از هوش مصنوعی در فضای آنلاین همکاری کنند.

تاثیرات احتمالی

استفاده از هوش مصنوعی در عملیات فریب اطلاعاتی میتواند پیامدهای منفی متعددی داشته باشد. این موضوع میتواند به گمراه شدن افکار عمومی، تضعیف اعتماد به نهادهای دموکراتیک و حتی ایجاد تنشهای اجتماعی و سیاسی منجر شود.

نقش هوش مصنوعی در انتخابات

انتخابات یکی از حوزههایی است که هوش مصنوعی میتواند در آن به طور بالقوه مورد سوءاستفاده قرار گیرد. تولید تصاویر و ویدیوهای جعلی از سیاستمداران، انتشار اخبار نادرست در مورد رقبای انتخاباتی و دستکاری افکار عمومی از طریق تبلیغات هدفمند، تنها تعدادی از نمونههای سوءاستفاده از هوش مصنوعی در انتخابات هستند.

آینده چه خواهد شد؟

متا و سایر شرکتهای فناوری در حال سرمایهگذاری در توسعه ابزارها و روشهای جدید برای شناسایی و مقابله با سوءاستفاده از هوش مصنوعی هستند. با این حال، این نبرد همچنان ادامه خواهد داشت و هوش مصنوعی مولد چالشی دائمی برای پلتفرمهای آنلاین و جامعه به طور کلی خواهد بود.

| پیشنهاد ویژه : تعمیر کامپیوتر |

| پیشنهاد ویژه : خرید بلیط هواپیما فلای تودی |

ارسال دیدگاه

مجموع دیدگاهها : 0در انتظار بررسی : 0انتشار یافته : ۰